Le profilage en Python est un outil puissant pour optimiser les charges de travail I/O. Il permet d’analyser et de comprendre le comportement des applications et de trouver des moyens d’améliorer les performances.

Optimiser les charges de travail I/O en Python

Testing the Performance

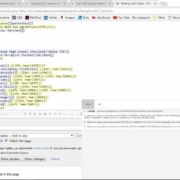

Once you have identified the type of I/O workloads, the next step is to test the performance. This can be done by running the code and measuring the time taken for execution. This will help you understand the areas that need to be optimized. You can also use profiling tools like cProfile and line_profiler to measure the performance of individual functions. These tools provide detailed information about the time taken for each function to execute.

Optimizing the Performance

Once you have identified the areas that need optimization, you can start applying strategies to reduce or manage the bottlenecks. For example, if your code involves multiple disk I/O operations, you can use caching to reduce the number of disk reads and writes. Similarly, if your code involves network I/O, you can use asynchronous programming techniques to improve the performance. Finally, if your code involves database I/O, you can use query optimization techniques to reduce the number of database queries.

Identifier les charges de travail d’E/S

Comprendre le type de charges de travail d’E/S est essentiel comme première étape. Est-ce qu’ils impliquent des opérations d’E/S sur disque, telles que des opérations de lecture/écriture de fichiers, des opérations d’E/S réseau, qui incluent la transmission de données sur un réseau, ou des opérations d’E/S de base de données, comprenant les interactions avec une base de données? Des techniques d’optimisation distinctes s’appliquent à chaque catégorie. J’ai pris en compte les goulots d’étranglement liés aux opérations E/S réseau et aux opérations de lecture/écriture de fichiers pour cet article.

Tester les performances

Une fois que vous avez identifié le type de charges de travail d’E/S, la prochaine étape consiste à tester les performances. Cela peut être fait en exécutant le code et en mesurant le temps nécessaire à son exécution. Cela vous aidera à comprendre les domaines qui doivent être optimisés. Vous pouvez également utiliser des outils de profilage tels que cProfile et line_profiler pour mesurer les performances de chaque fonction. Ces outils fournissent des informations détaillées sur le temps nécessaire à l’exécution de chaque fonction.

Optimiser les performances

Une fois que vous avez identifié les domaines qui doivent être optimisés, vous pouvez commencer à appliquer des stratégies pour réduire ou gérer les goulots d’étranglement. Par exemple, si votre code implique plusieurs opérations d’E/S sur disque, vous pouvez utiliser le cache pour réduire le nombre de lectures et d’écritures sur disque. De même, si votre code implique des opérations d’E/S réseau, vous pouvez utiliser des techniques de programmation asynchrones pour améliorer les performances. Enfin, si votre code implique des opérations d’E/S de base de données, vous pouvez utiliser des techniques d’optimisation des requêtes pour réduire le nombre de requêtes vers la base de données.

L’optimisation des charges de travail d’E/S en Python implique généralement la compréhension des goulots d’étranglement et l’application de stratégies pour les réduire ou les gérer. Le profilage est une ét