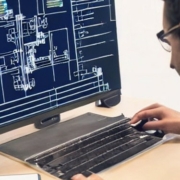

Déployer des infrastructures complexes et fiables n’a jamais été aussi simple! Exploitez Terraform et les bascules de fonctionnalités pour un déploiement d’infrastructure simplifié.

Les avantages de l’utilisation des bascules de fonctionnalités avec Terraform

Conclusion

Feature toggles are a powerful technique that can be used to streamline the deployment process of your infrastructure. By using feature toggles with Terraform, you can improve the safety, speed, and flexibility of your deployments while also enabling better testing. This makes feature toggles an invaluable tool for organizations looking to optimize their infrastructure deployment process.

Les avantages de l’utilisation des bascules de fonctionnalités dans Terraform

L’utilisation de bascules de fonctionnalités avec Terraform offre plusieurs avantages qui améliorent l’efficacité, la sécurité et la flexibilité de votre processus de déploiement d’infrastructure. Quelques-uns des principaux avantages sont les suivants :

Logiciel pour la gestion des bascules de fonctionnalités

Il existe plusieurs outils logiciels qui peuvent être utilisés pour gérer les bascules de fonctionnalités. Certains outils logiciels populaires comprennent LaunchDarkly, FeatureFlag.io et Flipper. Ces outils logiciels peuvent être intégrés à Terraform pour faciliter le déploiement et la gestion des bascules de fonctionnalités. Ces outils peuvent également être utilisés pour surveiller et analyser l’utilisation des bascules de fonctionnalités et leur impact sur les performances des applications et des infrastructures.

Conclusion

Les bascules de fonctionnalités sont une technique puissante qui peut être utilisée pour optimiser le processus de déploiement de votre infrastructure. En utilisant des bascules de fonctionnalités avec Terraform, vous pouvez améliorer la sécurité, la vitesse et la flexibilité de vos déploiements tout en permettant un