Le data mining est le processus d’extraction d’informations utiles à partir d’une accumulation de données, souvent à partir d’un data warehouse (entrepôt de données) ou d’une collection d’ensembles de données liés. Les outils de data mining incluent de puissantes fonctionnalités statistiques, mathématiques et analytiques dont l’objectif principal est de passer au crible de vastes ensembles de données pour identifier les tendances, les modèles et les relations, pour des prises de décisions et une planification éclairées.

Souvent associé aux demandes du service marketing, le data mining est considéré par de nombreux dirigeants comme un moyen de mieux comprendre la demande et de voir l’impact des modifications apportées aux produits, des prix ou des promotions sur les ventes. Mais le data mining présente également des avantages considérables pour d’autres domaines d’activité. Les ingénieurs et les concepteurs peuvent analyser l’efficacité des modifications de produit et rechercher les causes possibles de la réussite ou de l’échec d’un produit en fonction de la manière, du moment et du lieu d’utilisation des produits. Le MRO (entretien, réparation et fonctionnement) est en mesure de mieux planifier le stock de pièces et l’affectation du personnel. Les entreprises de services professionnels peuvent utiliser le data mining pour identifier les nouvelles opportunités liées à l’évolution des tendances économiques et aux changements démographiques.

Le data mining s’avère davantage utile et précieux maintenant que l’on se retrouve avec des ensembles de données plus volumineux et une expérience utilisateur accrue. Logiquement, plus il y a de données, plus elles cachent d’informations et de renseignements. Par ailleurs, plus les utilisateurs se familiarisent avec les outils et comprennent la base de données, plus ils deviennent créatifs vis-à-vis des explorations et des analyses.

Pourquoi utiliser le data mining ?

Le principal avantage du data mining est sa capacité à repérer des modèles et des relations dans de grands volumes de données provenant de plusieurs sources. Avec de plus en plus de données disponibles, provenant de sources aussi variées que les réseaux sociaux, les capteurs à distance et les rapports de plus en plus détaillés sur les mouvements de produits et l’activité du marché, le data mining offre les outils nécessaires pour exploiter pleinement le Big Data et le transformer en renseignements exploitables. De plus, il peut aider à « sortir des sentiers battus ».

Le processus de data mining peut détecter des relations et des modèles surprenants et intrigants dans des fragments d’informations apparemment non liées. Comme les informations tendent à être compartimentées, il a toujours été difficile, voire impossible, de les analyser dans leur ensemble. Toutefois, il peut exister une relation entre les facteurs externes (démographiques ou économiques, par exemple) et la performance des produits d’une entreprise. Les dirigeants, qui examinent régulièrement les chiffres des ventes par territoire, ligne de produits, canal de distribution et région, manquent souvent de contexte externe pour ces informations. Leur analyse souligne « ce qui s’est passé », mais ne détaille pas vraiment « pourquoi cela s’est passé de cette manière ». Le data mining peut apporter une solution.

Le data mining peut rechercher des corrélations avec des facteurs externes. Si la corrélation n’indique pas toujours la causalité, ces tendances peuvent être des indicateurs précieux pour guider les décisions relatives aux produits, aux canaux et à la production. La même analyse peut être bénéfique pour d’autres domaines de l’activité, de la conception de produit à l’efficacité opérationnelle, en passant par la prestation de services.

Historique du data mining

Nous collectons et analysons des données depuis des milliers d’années et, à bien des égards, le processus est resté le même : identifier les informations nécessaires, trouver des sources de données de qualité, collecter et combiner les données, utiliser les outils les plus efficaces pour analyser les données, et tirer parti des enseignements appris. À mesure que l’informatique et les systèmes basés sur les données se sont développés, il en a été de même pour les outils de gestion et d’analyse des données. Le véritable point d’inflexion est venu dans les années 1960 avec le développement de la technologie de base de données relationnelle et des outils de requête en langage naturel orienté utilisateur, tels que Structured Query Language (SQL). Les données n’étaient plus disponibles uniquement via des programmes codés personnalisés. Grâce à cette avancée, les utilisateurs pouvaient explorer leurs données de manière interactive et en extraire les « joyaux cachés ».

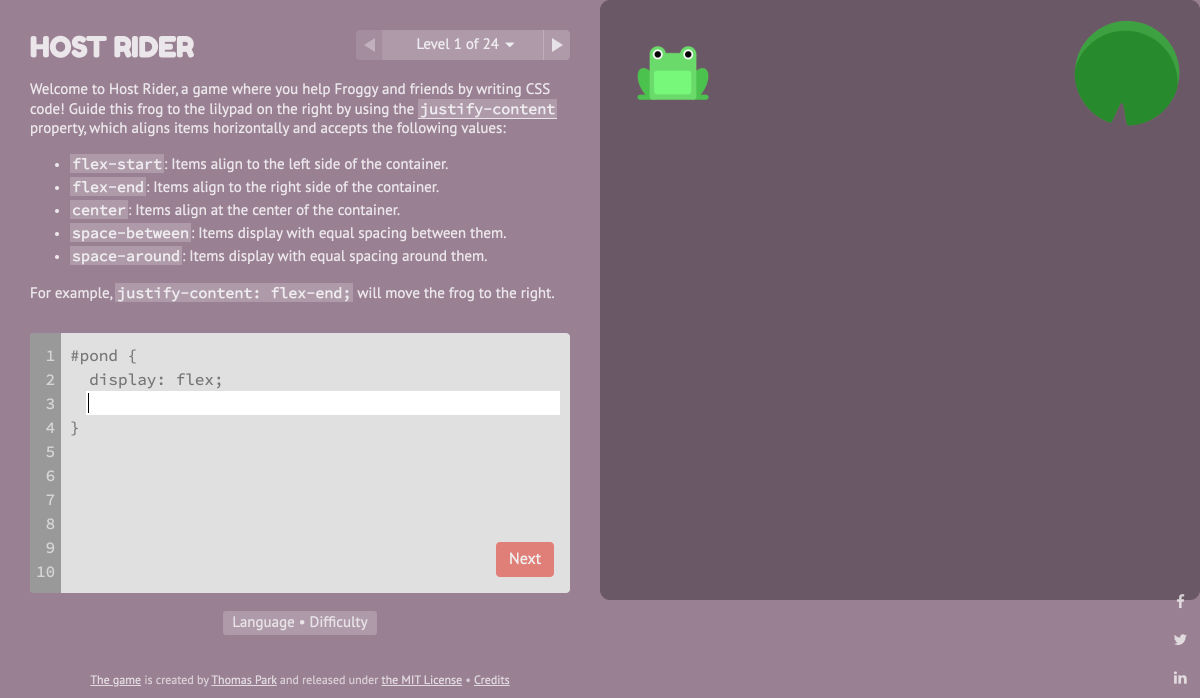

Le data mining est traditionnellement un ensemble de compétences spécialisées dans la science des données. Cependant, chaque nouvelle génération d’outils analytiques nécessite dans un premier temps des compétences techniques avancées, mais évolue rapidement pour devenir accessible aux utilisateurs. L’interactivité, c’est-à-dire la possibilité de laisser les données vous parler, est la principale avancée. Posez une question et visualisez la réponse. En fonction de ce que vous apprenez, posez une autre question. Ce type d’itinérance non structurée à travers les données permet à l’utilisateur d’aller au-delà des limites de la conception de bases de données spécifiques à une application et permet de découvrir des relations qui dépassent les limites fonctionnelles et organisationnelles.

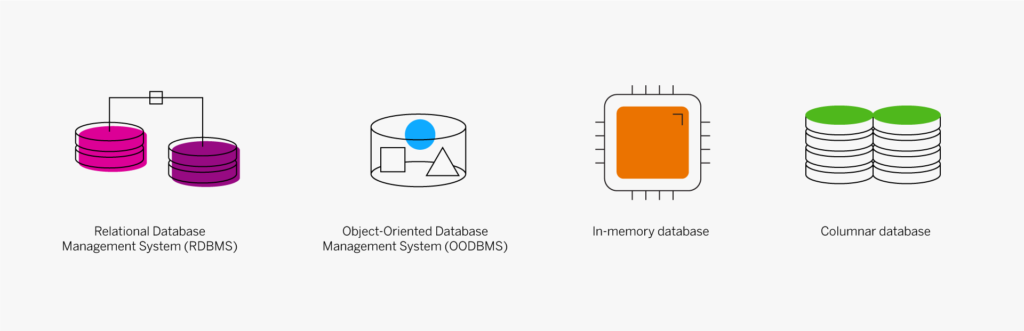

Le data mining est une composante clé de la Business Intelligence. Les outils d’exploration de données sont créés dans les tableaux de bord décisionnels, en extrayant des informations du Big Data, y compris les données des réseaux sociaux, des flux de capteurs IoT, des appareils de localisation, du texte non structuré, des vidéos, etc. Le data mining moderne s’appuie sur le Cloud, l’informatique virtuel et les bases de données in-memory pour gérer les données de diverses sources de manière rentable et s’adapter à la demande.

Comment cela fonctionne ?

Il y a environ autant d’approches du data mining qu’il y a d’explorateurs de données. L’approche dépend du type de questions posées, du contenu et de l’organisation de la base de données ou des ensembles de données fournissant la matière première pour la recherche et l’analyse. Cela dit, certaines étapes organisationnelles et préparatoires doivent être accomplies pour préparer les données, les outils et les utilisateurs :

- Comprendre le problème, ou du moins le domaine d’enquête.Le décideur, qui doit prendre les commandes de cette grande aventure de data mining, a besoin d’une compréhension générale du domaine dans lequel il travaillera, à savoir les types de données internes et externes qui doivent faire partie de cette exploration. On suppose qu’il a une connaissance approfondie de l’entreprise et des domaines fonctionnels impliqués.

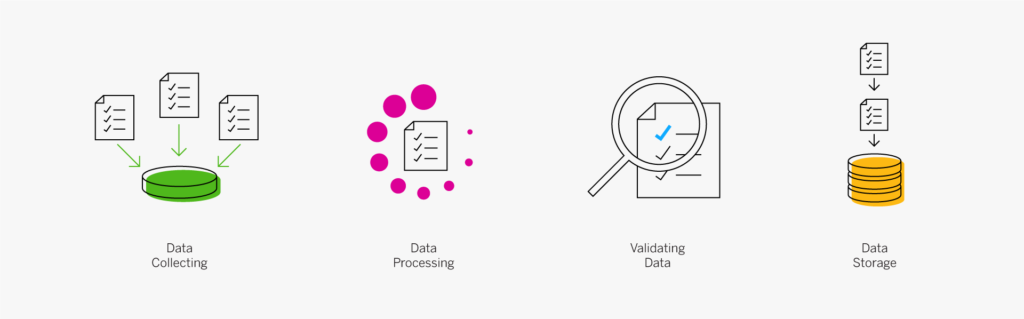

- Collecte de données. Commencez par vos systèmes et bases de données internes. Liez-les à l’aide de leurs modèles de données et de divers outils relationnels, ou rassemblez les données dans un entrepôt de données (data warehouse). Cela inclut toutes les données provenant de sources externes qui font partie de vos opérations, telles que les données de force de vente et/ou de service, les données IoT ou des réseaux sociaux. Recherchez et acquérez auprès des associations professionnelles et des gouvernements les droits sur les données externes, notamment les données démographiques, économiques et relatives au marché, telles que les tendances du secteur et les indices financiers. Intégrez-les dans le périmètre du kit d’outils (intégrez-les dans votre data warehouse ou reliez-les à l’environnement de data mining).

- Préparation et compréhension des données.Faites appel aux experts en la matière pour définir, catégoriser et organiser les données. Cette partie du processus est parfois appelée « remaniement des données ». Certaines données peuvent nécessiter un nettoyage pour supprimer les doublons, les incohérences, les enregistrements incomplets ou les formats obsolètes. La préparation et le nettoyage des données peuvent se poursuivre à mesure que de nouveaux projets ou des données provenant de nouveaux champs d’enquête deviennent intéressants.

- Formation des utilisateurs.Vous ne donneriez pas à votre adolescent les clés de la Ferrari sans qu’il n’ait appris à conduire ou qu’il n’ait pratiqué la conduite sur route avec un moniteur. Par conséquent, veillez à dispenser une formation formelle à vos futurs explorateurs de données et à les familiariser avec ces outils puissants. La formation continue est également bienvenue une fois qu’ils maîtrisent les bases et qu’ils peuvent passer à des techniques plus avancées.

Techniques de data mining

Gardez à l’esprit que l’exploration de données est basée sur un kit d’outils plutôt que sur une routine ou un processus fixe. Les techniques spécifiques de data mining citées ici ne sont que des exemples d’utilisation des outils par les organisations afin d’explorer leurs données et rechercher des tendances, des corrélations et des renseignements.

D’une manière générale, les approches de data mining peuvent être catégorisées comme étant orientées (vers un résultat spécifique souhaité) ou non orientées, comme un simple processus de découverte. D’autres explorations peuvent être destinées au tri ou à la classification des données, telles que le regroupement des clients potentiels en fonction d’attributs commerciaux comme le secteur, les produits, la taille et le lieu géographique. De même, la détection de cas particuliers ou d’anomalies est une méthode automatisée de reconnaissance des anomalies réelles (plutôt que simple variabilité) dans un ensemble de données qui affiche des modèles identifiables.

Association

Un autre objectif intéressant est l’association, qui relie deux événements ou activités apparemment non liés. Il existe un récit bien connu des débuts de l’analyse et du data mining, peut-être fictif, selon lequel une chaîne de magasins découvrait une corrélation entre les ventes de bière et de couches. Il avait été supposé que les nouveaux papas stressés qui sortaient tard le soir pour acheter des couches pouvaient aussi prendre un pack de 6 bières dans la foulée. Les magasins ont alors placé la bière et les couches à proximité, ce qui a augmenté les ventes de bière.

Clustering

Cette approche vise à regrouper les données par similitudes plutôt que par hypothèses prédéfinies. Par exemple, lorsque vous explorez vos informations commerciales clients combinées à des données externes démographiques et de crédit à la consommation, vous pourriez découvrir que vos clients les plus rentables vivent dans des villes de taille moyenne.

La majorité du temps, le data mining est exécuté en soutien à la prévision. Plus vous comprenez les modèles et les comportements, mieux vous pouvez prévoir les actions futures liées aux causes ou aux corrélations.

Régression

L’une des techniques mathématiques proposées dans les kits d’outils de data mining est l’analyse de régression, qui prédit un nombre en fonction de modèles historiques projetés dans le futur. Divers autres algorithmes de détection et de suivi des modèles fournissent des outils flexibles pour aider les utilisateurs à mieux comprendre les données et le comportement qu’elles représentent.

Ce ne sont là que quelques-uns des outils et des techniques disponibles dans les kits d’outils de data mining. Le choix de l’outil ou de la technique est en quelque sorte automatisé en ce sens que les techniques seront appliquées en fonction de la manière dont la question est posée. Auparavant, l’exploration de données revenait à « découper en tranches » la base de données, mais la pratique est aujourd’hui plus sophistiquée et les termes comme association, clustering et régression sont monnaie courante.

Exemples de cas d’utilisation

Le data mining est essentiel à l’analyse des sentiments, à l’optimisation des prix, au marketing de bases de données, à la gestion des risques de crédit, à la formation et à l’assistance, à la détection des fraudes, aux diagnostics médicaux, à l’évaluation des risques, aux systèmes de recommandation (à savoir, « les clients qui ont acheté ceci ont également aimé… »), et bien plus encore. Elle peut être un outil efficace dans pratiquement n’importe quel secteur, y compris la distribution de détail, la distribution de gros, les services, la fabrication, les télécommunications, les communications, les assurances, l’éducation, la santé, la banque, la science, l’ingénierie et le marketing en ligne ou les réseaux sociaux.

|

Développement de produit |

Les entreprises qui conçoivent, fabriquent ou distribuent des produits physiques peuvent identifier des opportunités pour mieux cibler leurs produits en analysant les habitudes d’achat conjuguées aux données économiques et démographiques. Leurs concepteurs et ingénieurs peuvent également recouper les commentaires des clients et des utilisateurs, les données de réparation et d’autres données pour identifier les opportunités d’amélioration des produits. |

|

Production |

Les fabricants peuvent suivre les tendances de qualité, les données de réparation, les taux de production et les données de performance des produits sur le terrain pour identifier les problèmes de production. Ils peuvent également détecter les améliorations pouvant être apportées aux processus afin d’accroître la qualité, gagner du temps, réduire les coûts, améliorer la performance des produits et/ou repérer tout besoin de renouvellement d’équipements. |

|

Industries |

Dans le secteur des services, les utilisateurs peuvent trouver des opportunités similaires d’amélioration des produits en comparant les commentaires des clients (directs ou publiés sur les réseaux sociaux ou d’autres sources) et les données relatives aux services, canaux, performance des pairs, régions, tarifs, ou encore les données démographiques ou économiques. |

Enfin, toutes ces découvertes doivent être transposées dans les prévisions et la planification afin que l’ensemble de l’entreprise soit en phase avec les changements de la demande anticipés grâce à une connaissance plus approfondie du client, et soit ainsi mieux positionnée pour exploiter les opportunités venant d’être identifiées.

Défis liés au data mining

- Big Data : la génération de données est de plus en plus rapide, ce qui offre de plus en plus d’opportunités pour le data mining. Cependant, des outils d’exploration de données modernes sont nécessaires pour extraire une signification du Big Data, compte tenu du volume élevé, de la grande rapidité et de la grande variété des structures de données, ainsi que du volume croissant de données non structurées. De nombreux systèmes existants ont du mal à gérer, à stocker et à utiliser ce grand flux d’intrants.

- Compétence de l’utilisateur : les outils d’exploration et d’analyses des données sont conçus pour aider les utilisateurs et les décideurs à comprendre et à obtenir des informations à partir de grands volumes de données. Bien que hautement techniques, ces outils puissants offrent désormais une excellente expérience utilisateur, de sorte que pratiquement tous les utilisateurs sont en mesure d’utiliser ces outils avec un minimum de formation. Toutefois, pour tirer pleinement profit des avantages, l’utilisateur doit comprendre les données disponibles et le contexte commercial des informations qu’il recherche. Il doit également savoir, au moins de manière générale, comment fonctionnent les outils et ce qu’ils peuvent faire. Ces outils ne sont pas hors de portée du responsable ou dirigeant moyen, mais nécessitent un apprentissage, raison pour laquelle les utilisateurs doivent consacrer du temps au développement de cette nouvelle compétence.

- Qualité et disponibilité des données : avec ces énormes quantités de nouvelles données, il existe également des masses de données incomplètes, incorrectes, trompeuses, frauduleuses, endommagées ou simplement inutiles. Les outils peuvent contribuer à résoudre ce problème, mais les utilisateurs doivent constamment tenir compte de la source des données et de sa crédibilité et fiabilité. Les préoccupations en matière de confidentialité sont également importantes, tant en ce qui concerne l’acquisition des données que la prise en charge et la gestion une fois qu’elles sont en votre possession.

Renforcez votre expertise en matière de gestion des données

Comprenez le processus de gestion des données et les avantages qu’il peut apporter à votre organisation.

FAQ sur le data mining

Quelle est la différence entre le machine learning et le data mining ?

Le data mining consiste à utiliser des outils analytiques avancés pour extraire des informations utiles d’une accumulation de données. Le machine learning est un type d’intelligence artificielle (IA) qui permet aux systèmes d’apprendre par l’expérience. L’exploration de données peut utiliser le machine learning lorsque les programmes analytiques ont la possibilité d’adapter leurs fonctionnalités en fonction de l’analyse de données qu’ils effectuent.

Existe-t-il une différence entre le data mining et l’analyse de données ?

L’analyse des données est un terme général pour le large éventail de pratiques visant à identifier les informations utiles, à les évaluer et à fournir des réponses spécifiques. Le data mining est un type d’analyse des données qui se concentre sur l’exploration de grands ensembles de données combinés pour découvrir des modèles, des tendances et des relations susceptibles de générer des informations et des prévisions.

Le data mining est-il identique à la science des données ?

La science des données est un terme qui inclut de nombreuses technologies de l’information, y compris les statistiques, les mathématiques et les techniques de calcul sophistiquées appliquées aux données. Le data mining est un cas d’utilisation de la science des données centré sur l’analyse de grands ensembles de données provenant d’un large éventail de sources.

Le data mining est-il identique au data warehouse ?

Un data warehouse est un ensemble de données, généralement provenant de sources multiples (ERP, CRM, par exemple) qu’une entreprise rassemblera dans l’entrepôt à des fins d’archivage et d’analyse à grande échelle, comme le data mining.

The post Qu’est-ce que le data mining ? appeared first on SAP France News.

Every week users submit a lot of interesting stuff on our sister site Webdesigner News, highlighting great content from around the web that can be of interest to web designers.

Every week users submit a lot of interesting stuff on our sister site Webdesigner News, highlighting great content from around the web that can be of interest to web designers.