L’IA et l’IA générative sont des technologies qui offrent de nouvelles possibilités de voyage et de fonctionnement. Découvrons ensemble leurs avantages et leurs limites.

Ces dernières années, les technologies et services de pointe ont considérablement changé leurs directions, dynamiques et cas d’utilisation. Il est clair que la dernière vague d’adoption technologique mondiale par les industries est submergée par l’intelligence artificielle (IA) et ses différentes formes. L’IA s’intègre de plus en plus dans le tissu de notre vie quotidienne, changeant la façon dont nous vivons et travaillons. Cet article discute des bases de l’IA / ML, de son utilisation, de l’évolution de l’IA générative, de l’ingénierie prompte et de LangChain.

Machine Learning (ML) is a subset of AI that uses algorithms to learn from data and make predictions. ML algorithms are used to identify patterns in large datasets and then use those patterns to make predictions about future data. ML algorithms can be used to identify customer preferences, detect fraud, and recommend products.

L’intelligence artificielle et l’apprentissage automatique

L’intelligence artificielle (IA) est la capacité de simuler l’intelligence humaine et les processus de pensée tels que l’apprentissage et la résolution de problèmes. Il peut effectuer des tâches complexes qui historiquement ne pouvaient être effectuées que par des humains. Grâce à l’IA, un système non humain utilise des approches mathématiques et logiques pour simuler la raisonnement que les gens utilisent pour apprendre de nouvelles informations et prendre des décisions.

L’apprentissage automatique (ML) est un sous-ensemble de l’IA qui utilise des algorithmes pour apprendre des données et effectuer des prédictions. Les algorithmes d’apprentissage automatique sont utilisés pour identifier des modèles dans de grands ensembles de données et ensuite utiliser ces modèles pour effectuer des prédictions sur des données futures. Les algorithmes d’apprentissage automatique peuvent être utilisés pour identifier les préférences des clients, détecter la fraude et recommander des produits.

L’évolution de l’intelligence générative et le LangChain

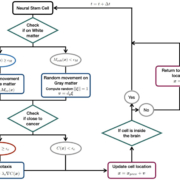

L’intelligence générative (GI) est une forme avancée d’IA qui permet aux systèmes informatiques d’apprendre à partir de données et de générer des résultats sans être explicitement programmés pour le faire. Les systèmes GI peuvent apprendre à partir de données complexes et générer des résultats qui peuvent être utilisés pour prendre des décisions ou même créer des produits. Les systèmes GI sont utilisés pour la recherche, le développement de produits, la prise de décision et la gestion des bases de données.

Le LangChain est une technologie basée sur l’IA qui permet aux systèmes informatiques d’analyser les données textuelles et de les transformer en informations utiles. Le LangChain peut être utilisé pour extraire des informations à partir de documents, d’articles, de messages et même de conversations. Il peut également être utilisé pour générer des rapports, des recommandations et des prédictions basés sur les données textuelles.

En conclusion, l’IA et l’apprentissage automatique sont en train de révolutionner le monde numérique. Les technologies telles que l’intelligence générative et le LangChain offrent aux entreprises une variété de possibilités pour tirer parti des données et améliorer leurs opérations. Ces technologies sont en train de transformer radicalement la manière dont les entreprises interagissent avec leurs clients et leurs bases de données.